El proyecto “One Laptop Per Child” reescribió varias reglas al proponer un ordenador portátil de 99 dólares. La suma resultó ser demasiado optimista en su momento, pero el concepto inspiró la creación de sistemas como la Eee PC, llevando a sistemas cada vez más poderosos a un precio de mercado menor. Sin embargo, la gente de Adapteva planea ir más allá con su proyecto Parallella, creando una plataforma de bajo costo que permita una mayor adopción de herramientas para el desarrollo de procesamiento paralelo. La prensa especializada presenta a Parallella como “un superordenador de 99 dólares”. ¿Será así?

No me quedan dudas de que todo usuario desea que su ordenador funcione más rápido, y lo mismo se aplica a los smartphones y las tablets que hay disponibles. Pero el “poder de procesamiento” tiene valor siempre y cuando su aplicación sea la correcta. Un usuario quiere buena respuesta en la interfaz, durante la sesión de navegación, y por supuesto en procesos más intensos como es la edición de audio/vídeo/imágenes, o los juegos y otras formas de entretenimiento. Tanto el hardware como el software han hecho muchos avances, pero sabemos que existe un límite, y no son pocos los que creen que el procesamiento paralelo es la solución para superar ese límite. Lamentablemente, los costos de desarrollo para esa clase de entornos son bastante altos, por lo tanto, un buen atajo es facilitar el acceso a un hardware de procesamiento paralelo y a herramientas de software que permitan explotarlo.

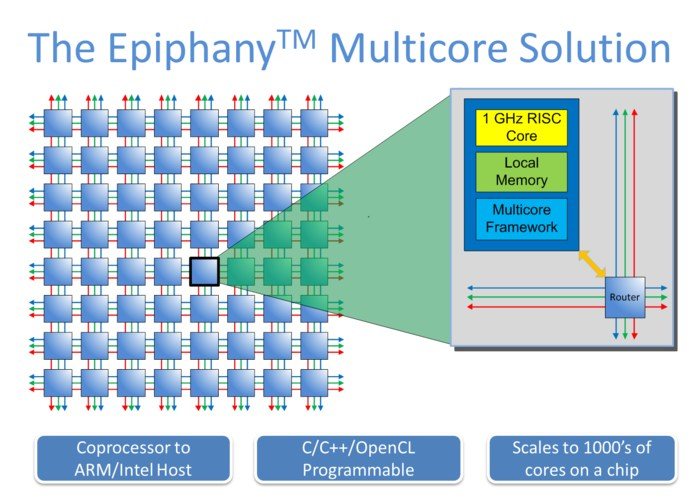

Así es como encontramos a Parallella. De acuerdo a lo que ha publicado Adapteva al respecto, Parallella está inspirado en otros proyectos de bajo costo como el hardware Arduino o el famoso Raspberry Pi, pero con una vuelta de tuerca extra: Popularizar el acceso al procesamiento paralelo. El hardware que le da forma a Parallella utiliza uno de los chips Epiphany que Adapteva lleva desarrollando desde hace un tiempo. Estos chips aceleradores están compuestos por una red de núcleos RISC operando a una frecuencia de 1 Ghz. De acuerdo al modelo, un chip Epiphany puede tener 16 o 64 núcleos. Si el desarrollo se completa, Adapteva habla de un equivalente a 45 Ghz de rendimiento convencional, con un consumo de energía en el orden de los cinco vatios, y el tamaño de una tarjeta de crédito. En lo personal creo que esos 45 Ghz están un poco inflados, pero me gustaría ver si pueden lograrlo.

Como siempre suele suceder en estos casos, la teoría parece ser bastante buena, pero al menos en lo que se refiere a este proyecto de Kickstarter, es necesario proceder con una pizca de cautela (por eso el “superordenador” entre comillas en el título). Las razones son estrictamente técnicas: Varios comentarios a través de la Web cuestionan el uso del término superordenador para lo que en esencia es una unidad de punto flotante adicional con núcleos operando a 1 Ghz. De todas maneras, imagino que la gente de Adapteva buscará ir más allá de esa descripción, antes de que sea económicamente viable conectar 20 o 30 placas Parallella juntas. Si se llega al objetivo principal (750 mil dólares) el paquete de desarrollo, el diseño hardware y el resto del software asociado será completamente abierto. Y con una base de 99 dólares (ese es el número del que habla Adapteva), por más que su aplicación tienda a ser específica, definitivamente llamará la atención a más de uno.

increible

nada que no se pueda hacer con un GPU actual, de hecho ahora permiten mejores cosas, la cosa es que no sale a cuenta, ya que, que tipo de programas son realmente útiles para esto?

han conseguido ejecutar instrucciones normales en un gpu?

cuando lo consigan que inventen esto, hasta entonces están tirando la potencia de las GPU, y hacen un invento inferior a ellas para ganar money.

esto no es nada mas que un CPU con arquitectura de GPU, básicamente solo sirve para cosas muy concretas, y para eso podrían pensar en usar los GPU, y invertir en compiladores y MEJORAR EL SOFTWARE a nivel básico, pues si hacen un programa y han de pensar en el GPU, se van a morir en el intento la gran mayoría de los desarrolladores, pero si lo hace todo de manera transparente el compilador, ejecutando parte del código en una parte o en otra dependiendo de su ventaja de rendimiento, o consiguiendo paralelizar TODO el código (cosa bastante difícil) con algún algoritmo raro que se inventen.

hasta entonces hacer este tipo de chips es tirar el tiempo, pues para esto están las GPU con muchos mas núcleos, FPU mucho mejores, que ejecutan muchas mas instrucciones (De su tipo) a la vez.

entonces, por que no usar el GPU como coprocesador?

porque cuesta mucha pasta invertir en software, mas que en inventarse esto, que no tiene nada de nuevo, solo es un trozo de CPU mejorado, faltando otras partes de él, pues estos 45 GHZ, es muy falso, no se puede medir un procesador en ghz…

porque si lo que hacen es sumar núcleos y decir que 4 a 1 ghz equivalen a 4 ghz, se meten muchos muchos muchos tripis, y no solo esto, quieren que nos lo creamos, pues que software es capaz de aprovechar los 4 núcleos EXACTAMENTE AL MISMO TIEMPO Y A LA VEZ?

entonces un quad core seria cuatro veces mejor que un unicore, y no es así, no, no lo es, para unas cosas va mejor uno, para otras va mejor otro, porque el software es incapaz de ejecutarse exactamente dividido entre tantos núcleos como haya, el día que se invente esto, bienvenidos sean los núcleos como forma de medir la potencia.

la unica forma de medirla es con benchmarks, y son tan irreales como su nombre indica, pruebas SINTETICAS.

vamos que solo sirve para unas cosas en concreto y ya esta, y los GPU lo harían mejor.

falta mucha información para que yo vea esto como serio y útil.

lo malo de one laptop per child como las XO es que es un sistema cerrado, bloqueado adrede, sin opcion a experimentar, mejorarlo y optimizarlo. Es un sinsentido si la idea es que todo niño acceda a la tecnología y sea mas creativo.

La real utilidad que yo veo para este tipo de computadores es la robótica e inteligencia artificial, ¿pues qué mejor GPU que un ordenador de éstas características?. La respuesta del supuesto robot sería inmediata con esas velocidades de procesamiento. Y si pretenden comercializar éste ordenador a 99 dólares la cosa pinta muy bien para ingenieros que se dediquen a la rama de robótica.