Durante la última edición de su conferencia I/O, Google dejó muy en claro su interés en la tecnología vestible. Uno de los ejemplos más contundentes sobre el escenario fue Jacquard, proyecto que busca crear telas con soporte táctil. Sin embargo, Jacquard está acompañado por una iniciativa con objetivos similares, llamada Project Soli. La idea aquí es reconocer los gestos del usuario «en el aire» a través de un radar miniaturizado, el cual detecta ligeras perturbaciones y las vincula a comandos específicos en una interfaz.

Se supone que 2014 fue «el año de los dispositivos vestibles», pero el gran impacto de los accesorios disponibles no se ha materializado del todo. Funciones, formatos, precio… hay algo de fondo que todavía no cierra de los múltiples relojes, brazaletes y sensores que se abrieron paso en conferencias y keynotes. Algunos creen que es una cuestión de interfaces. Si lo pensamos por un momento, los relojes inteligentes son casi smartphones en tamaño reducido, ya que debemos tocar su pantalla una y otra vez para transmitir nuestros comandos (a menos que su reconocimiento de voz sea sólido). Básicamente, eso nos hace pensar en redundancia. Las compañías insisten en que los relojes inteligentes y los dispositivos vestibles en general son «complementos» para el smartphone de turno, pero se necesita desarrollar un método de uso mucho más intuitivo del que ofrecen hoy.

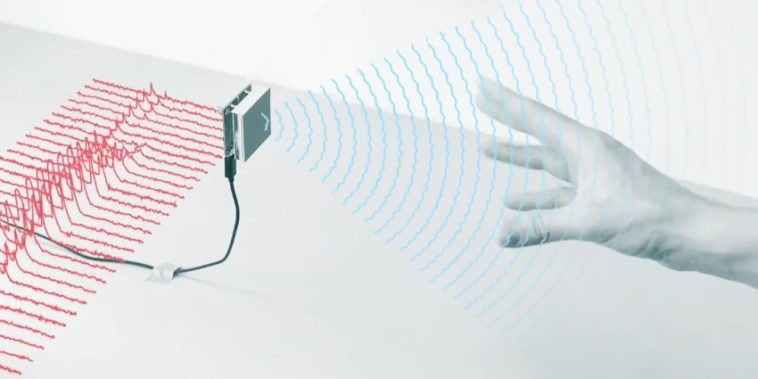

Ahí es cuando interviene Project Soli. Esta creación del grupo ATAP de Google planea implementar un sistema de reconocimiento de gestos basado en un radar miniaturizado. La tecnología trabaja a una frecuencia de 60 GHz con una longitud de onda de cinco milímetros, y un alcance que va desde los 0.05 hasta los 5 metros. La señal de 60 GHz posee la resolución adecuada para detectar hasta los más pequeños movimientos en los dedos del usuario, y con la ayuda de cuatro receptores, su plataforma de hardware actual puede lidiar con aquellos detalles de ruido y pérdida de precisión. El resto del trabajo es responsabilidad de los algoritmos, y los desarrolladores encargados de crear aplicaciones a su alrededor. Desde el scrolling hasta el control de audio, los ejemplos que da Google en el vídeo son bastante lógicos, pero es fácil imaginar que las ideas no se van a detener ahí.

Al estar bajo el ala de ATAP, es prácticamente imposible calcular si Google va a lanzar una variante de Project Soli al mercado, pero se trata de un proyecto demasiado avanzado como para ignorarlo. Los dispositivos vestibles necesitan toda la ayuda que puedan recibir, y la posibilidad de eliminar por completo la interacción táctil suena mucho más poderosa de lo que imaginamos.