Cuando generamos imágenes con inteligencia artificial, lo cierto es que tenemos mucho menos control del que imaginamos. Si bien podemos hacer una ingeniería de prompts bastante profunda, llega un momento en el que básicamente debemos tirar los dados. Sin embargo, un proyecto llamado DragGAN presenta una nueva generación de edición dinámica basada en la manipulación de puntos, permitiendo al usuario alterar la apariencia, la posición y el ángulo de personas y objetos en una imagen con relativa facilidad.

Cualquiera que haya experimentado con Midjourney, Stable Diffusion u otros modelos de generación de imágenes sabe que un mismo prompt puede producir resultados muy diferentes. La forma más efectiva de repetirlos es conservando la semilla (seed) de la imagen, pero si lo que buscamos es un leve cambio de ángulo, una sonrisa, o la corrección de un error específico, el prompt no es el mejor recurso para hacerlo. Hay demasiadas variables en juego, y lo más probable es que el modelo simplemente no coopere.

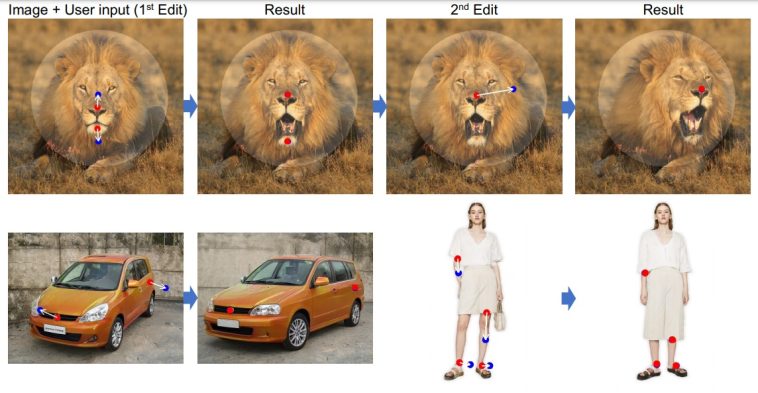

Eso nos lleva a la edición de imágenes, y un nuevo proyecto llamado DragGAN promete ser verdaderamente revolucionario. En la Web ya lo están describiendo como un «asesino de Photoshop», o una versión mucho más avanzada y potente de su función Warp. En esencia, el usuario puede manipular la condición general de una imagen a través de una serie de puntos, cambiando perfiles, direcciones y estilos… pero la mejor forma de explicarlo es con un vídeo.

DragGAN: ¿El futuro de la edición de imágenes?

Con la asistencia de DragGAN, cualquier usuario puede deformar una imagen sin sacrificar control sobre la dirección de los píxeles, efectivamente modificando aspectos como pose, expresión, o la disposición general de animales, coches, humanos, paisajes, y más. La demostración está acelerada, y nos hace sospechar que DragGAN requiere un poder de procesamiento bastante amplio, pero no por eso deja de ser impresionante. Todo lo contrario: La intervención del usuario se reduce a definir los puntos de manipulación (rojo) y los puntos de destino (azul). Como alternativa, también existe la posibilidad de dibujar una máscara para limitar la región flexible, e ignorar/aislar el resto de la imagen.

Imagino que será necesario esperar un tiempo para que veamos las primeras herramientas precompiladas, pero con semejante potencial, cualquier demora valdrá la pena. DragGAN va mucho más allá de la clásica edición de imágenes, cambiando su esencia por completo. Si deseas ver más demos, el enlace a la página oficial aparece abajo.

Anuncio oficial y PDF: Haz clic aquí