Los más recientes dispositivos, tanto en el aspecto móvil como en el entorno del entretenimiento, están dejando en evidencia diferentes formas en las que se puede prescindir de métodos de control más convencionales como el ratón y el teclado. Aunque este combo es particularmente fuerte en un ordenador de escritorio o una portátil, la tecnología no tiene ninguna restricción que le impida a un ordenador de escritorio comportarse de acuerdo a la cercanía que tiene el usuario a la pantalla, más allá del desarrollo de software necesario. Apenas se trata de una prueba de concepto, pero en teoría Ubuntu podría alterar la forma en que presenta los datos en la pantalla, según la distancia y los movimientos que realice el usuario.

Tenemos a la Nintendo Wii. También tenemos el PlayStation Move, y el Kinect de Microsoft. El iPhone introdujo de forma masiva la rotación automática (modo apaisado o "landscape", según la preferencia), y muchos otros dispositivos han imitado a esta función. Las pantallas táctiles han tomado por asalto a toda una nueva generación de usuarios, mientras que las tablets son cada vez más en el mercado. Y todo esto, sin un ratón ni un teclado a la vista. Convengamos que para un ingreso de datos rápido y eficiente, esta pareja se mantiene invicta, pero cuanto más pequeño y portátil es el dispositivo, más creativas deben ser sus formas de control. Por el lado de la Wii, su control ha sido revolucionario no solo para los jugadores, sino también para aquellos entusiastas que encontraron usos muy diferentes a esa tecnología. El Move y el Kinect no dejan de ser dos respuestas ante el éxito del control de la Wii, pero en un contexto global, se puede llegar a la conclusión de que los usuarios tienden a buscar formas más naturales de utilizar la tecnología, y el hardware se está adaptando a ello.

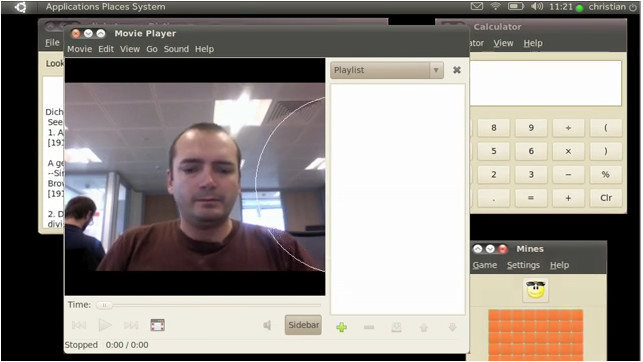

Al mismo tiempo, esta clase de comportamiento podría llegar a los ordenadores de escritorio, siempre y cuando el desarrollo sea suficiente. No estamos hablando de rotar el monitor y cambiar su orientación (¡horror!), sino de algo más elemental como por ejemplo, que el ordenador reconozca que estamos alejados de la pantalla, o que nuestra posición no es completamente centrada. De acuerdo a Christian Giordano, del blog de diseño de Canonical, sería posible diseñar una especie de software de proximidad que altere la forma en la que el sistema operativo presenta los datos en la pantalla, tomando como parámetro principal la posición del usuario. Por ejemplo: Si el usuario se aleja de la pantalla mientras se reproduce un vídeo en una ventana en primer plano, el vídeo pasaría a pantalla completa. En otro caso similar, cualquier notificación que en circunstancias normales podría aparecer como un pequeño mensaje, sería presentada en pantalla completa si el usuario no está frente al ordenador, para llamar más rápidamente su atención.

Y por supuesto, el simple hecho de detectar movimiento también abre la posibilidad para reconocer gestos y movimientos (una forma muy cruda de "Minority Report"), si la precisión en la detección de movimiento resulta lo suficientemente fina. En resumen, sólo se trata de la exploración de una posible función, y en cierta forma, la apertura de un nuevo debate. La gente detrás de Ubuntu no está desarrollando esto de forma activa, pero todo depende de cuál sea el nivel de interés por parte de los usuarios. ¿Acaso tendríamos una experiencia más rica en nuestros sistemas si estos se adaptaran a nuestros movimientos, o sólo contribuiría a hacer más confusa su operación? Como siempre, los comentarios están abiertos.